6-12 aydan sonra deepfake videoları real videolardan ayırmaq qeyri mümkün olacaq

Elm & Texnologiya

25.09.2019

Emil

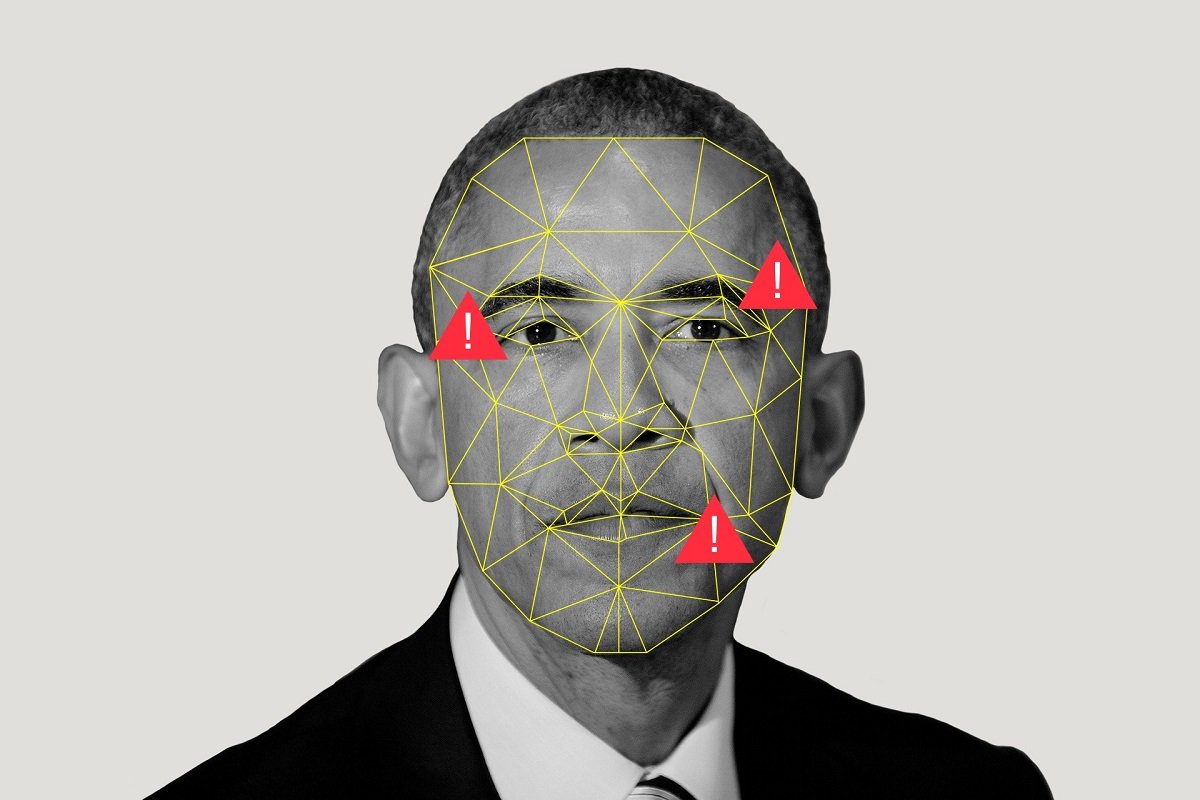

Saxta videoların hazırlanması üçün nəzərdə tutulmuş texnologiyalar sahəsində fəaliyyət göstərən aparıcı mütəxəssis Hao Li hələ bir neçə müddət bundan öncə bildirmişdi ki, bu cür texnologiyaların pik inkişaf səviyyəsi bir neçə ildən sonra baş tutacaq. Lakin o öz proqnozunu yeniləyib. Belə ki, Hao Li-nin yeni proqnozunda müddət göstəricisi illər deyil aylar təşkil edib. Bu isə o deməkdir ki, inandırıcı görünən deepfake videolar ABŞ-da baş tutacaq prezident seçkilərindən öncə keçiriləcək seçkiqabağı kampaniya dövründə artıq mümkün olacaq. Heç istisna deyil ki, həmin deepfake videolar seçkilərin nəticələrinə təsir göstərsinlər.

Deepfake videolar sahəsində fəaliyyət göstərən aparıcı mütəxəssis Hao Li əmindir ki, maksimum növbəti 12 ay ərzində insanların daha öncədən səsləndirmədikləri sözlərin və ya dialoqların əks olunduqları saxta videoları real videolardan ayırmaq qeyri mümkün olacaq. Bu barədə CNBC saytı xəbər verib. Hələ bu ayın ortasında keçirilmiş Emtech adlı konfrans çərçivəsində o qeyd etmişdi ki, bu cür texnologiyaların yüksək səviyyədə inkişafları üçün illər lazım olacaq. Beləliklə Hao Li öz proqnozunu bir neçə gün ərzində dəyişib. Beləliklə bizim, saxta videoları real videolardan ayırmağı öyrənməyimiz üçün 6-12 ay vaxtımız var.

Proqnozun ikinci hissəsi isə ondan ibarətdir ki, bu cür deepfake videoları adi istifadəçilər heç bir texniki bilik və ya təchizat olmadan yarada biləcəklər. “Yaxın zamanda vəziyyət elə bir həddə çatacaq ki, biz ümumiyyətlə saxta videoları real videolardan ayıra bilməyəcəyik. Buna görə də biz digər üsullar axtarmalı olacağıq” - deyə Hao Li öz müsahibəsində qeyd edib. Hao Li bildirib ki, onun proqnozunun bu cür tez bir zamanda dəyişməsinin əsas səbəbi insanların deepfake sahəsinə maraqlarının artmasında və Zao servisinin məşhurlaşmasındadır. Belə ki, sözügedən servisə istifadəçinin bir ədəd fotosu bəs edir ki, o, videolardakı şəxslərin üzlərini həmin istifadəçinin üzü ilə əvəz etsin.

Paylaş

Bənzər xəbərlər

Ən çox oxunanlar

Qatlana bilən Honor Magic V5 təqdim olunub - QİYMƏTİ